更多“设信源模型为,每秒发出3.5个信源符号,将此信源的输出通过某…”相关的问题

更多“设信源模型为,每秒发出3.5个信源符号,将此信源的输出通过某…”相关的问题

19.设某离散平稳信源X,概率空间为

并设信源发出的符号只与前一个相邻符号有关,其联合概率为p(aiaj)如下表所示。

并设信源发出的符号只与前一个相邻符号有关,其联合概率为p(aiaj)如下表所示。

| 联合概率p(aiaj) | ||||

| p(aiaj) | ai | |||

| 0 | 1 | 2 | ||

| aj | 0 | 1/4 | 1/18 | 0 |

| 1 | 1/18 | 1/3 | 1/18 | |

| 2 | 0 | 1/18 | 7/36 |

求信源的信息熵、条件熵与联合熵,并比较信息熵与条件熵的大小。

19.设某离散平稳信源X,概率空间为

并设信源发出的符号只与前一个相邻符号有关,其联合概率为p(aiaj)如下表所示。

| 联合概率p(aiaj) | ||||

| p(aiaj) | ai | |||

| 0 | 1 | 2 | ||

| aj | 0 | 1/4 | 1/18 | 0 |

| 1 | 1/18 | 1/3 | 1/18 | |

| 2 | 0 | 1/18 | 7/36 |

求信源的信息熵、条件熵与联合熵,并比较信息熵与条件熵的大小。

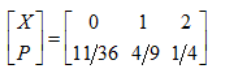

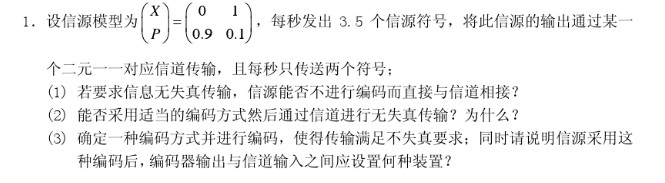

设信源模型为

(1)码符号集为X= {0,1,2},试对信源进行Huffman编码并求平均码长、编码效率和编码后信息传输速率。

(2)构造一种有约束的具有最小平均长度的异前置码,此约束是每个码字的第1个符号可以是0,1,2;后续的符号为0或1。

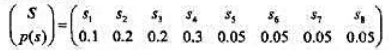

一信源有6种输出状态,概率分别为

p(A)=0.5,p(B)=0.25,p(C)=0.125,p(D)=p(E)=0.05,p(F)=0.025

试计算H(X)。然后求消息ABABBA和FDDFDF的信息量(设信源先后发出的符号相互独立),并将之与长度为6的消息序列信息量的期望值相比较。

已知信源U={0,1},信宿V={0,1,2}。设信源输入符号等概率分布,失真矩阵为

求信源的率失真函数R(D)。

设m阶马尔可夫信源S,其符号集A={x1,x2,…xq},又设p1,p2,…,pq为其平稳后的一维概率分布,现定义一无记忆信源

设离散无记忆信源S其符号集A={a1,a2,…,aq},知其相应的概率分布为(P1,P2,…,Pq)。设另一离散无记忆信源S,其符号集为S信源符号集的两倍,A={ai}i=1,2,…,2q,并且各符号的概率分布满足 Pi=(1 - ε)Pi(i=1,2,…,q) Pi=εPi-q(i=q+1,q+2,…,2q) 试写出信源S的信息熵与信源S的信息熵的关系。

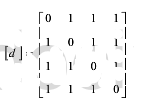

设输入符号集与输出符号集为X=Y={0,1,2,3},且输入信源的分布为

P(X=i)=1/4,i=1,2,3,4

设失真矩阵为 ,求Dmax、Dmin及R(D)。

,求Dmax、Dmin及R(D)。

如果结果不匹配,请

如果结果不匹配,请